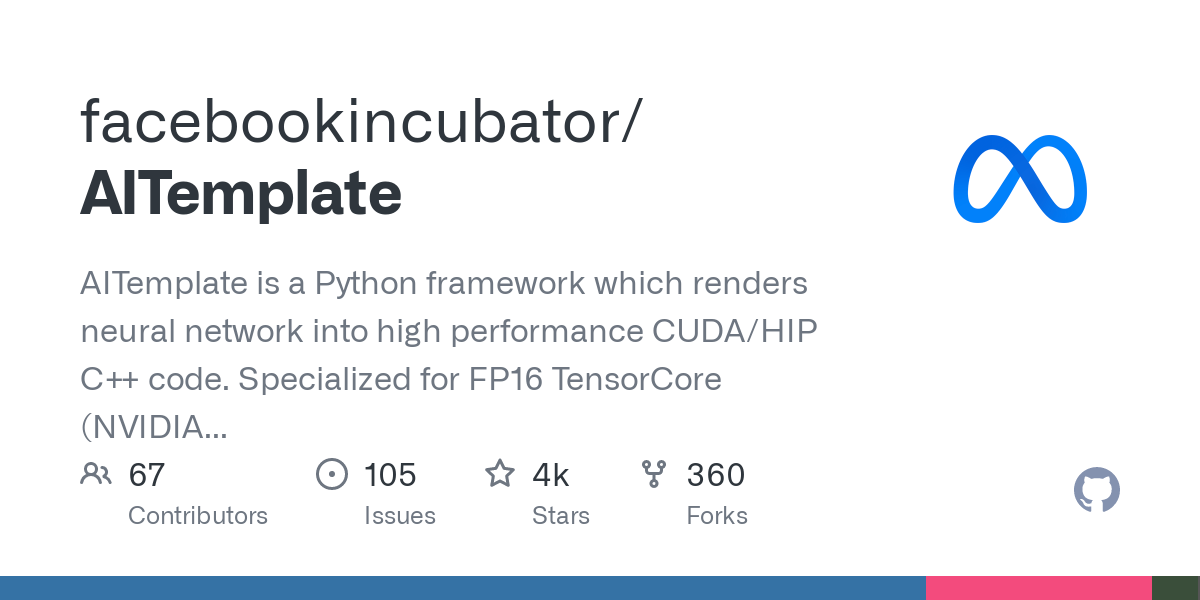

What is AITemplate?

Découvrez AITemplate, le framework Python de pointe qui révolutionne l'inférence des réseaux neuronaux profonds en traduisant les modèles en code C++ CUDA et HIP ultra-rapide. Offrant des performances élevées, une flexibilité open-source et des capacités de fusion avancées, AITemplate excelle dans la fourniture d'inférences à la vitesse de l'éclair pour un large éventail de modèles, de ResNet et MaskRCNN à BERT et VisionTransformer. Son approche unique garantit une excellente compatibilité descendante, sans avoir besoin de bibliothèques tierces, et prend en charge la fusion horizontale, verticale et de la mémoire pour des performances optimisées.

Fonctionnalités clés :

⚡️ Inférence haute performance :

AITemplate présente des performances TensorCore et MatrixCore quasi-maximales en fp16 sur les principaux modèles, notamment ResNet, MaskRCNN, BERT, VisionTransformer et Stable Diffusion.? Unifié, ouvert et flexible :

Faites fonctionner de manière transparente des réseaux neuronaux profonds fp16 sur des GPU NVIDIA ou AMD, en tirant parti d'un framework entièrement open-source avec une extensibilité de type Lego pour de nouveaux modèles.? Capacités de fusion avancées :

AITemplate offre des capacités de fusion horizontale, verticale et de la mémoire uniques, intégrant un large éventail d'opérations en noyaux uniques optimisés.? Fusion de la mémoire :

Des techniques innovantes de fusion de la mémoire fusionnent GEMM, LayerNorm et d'autres opérateurs avec des opérations de mémoire pour une exécution simplifiée.? Binaires autonomes :

Les modèles sont compilés en binaires portables, fonctionnels dans divers environnements logiciels tant que le matériel correspond.? Intégration PyTorch :

L'exécution Python AITemplate s'intègre sans effort aux tenseurs PyTorch, offrant une transition en douceur pour les environnements avec ou sans PyTorch.

Cas d'utilisation :

Serveur d'inférence ultra-rapide dans les plateformes de conduite autonome :

AITemplate accélère l'inférence des modèles, optimisant les processus de prise de décision pour des véhicules autonomes plus sûrs et plus efficaces.Traitement d'images en temps réel amélioré dans les systèmes de surveillance :

L'inférence rationalisée renforce la détection et le suivi d'objets en temps réel, améliorant les capacités de sécurité et de surveillance.Analyses d'imagerie médicale alimentées par l'IA accélérées :

L'exécution accélérée des modèles accélère les diagnostics, aidant les professionnels de la santé dans l'analyse rapide et précise des images médicales.

Conclusion :

AITemplate est votre passerelle vers l'avenir de l'inférence des réseaux neuronaux profonds. En tirant parti de ses capacités de haute performance, de sa flexibilité open-source et de ses techniques de fusion avancées, vous pouvez vivre une expérience de vitesse et d'efficacité sans précédent dans vos opérations d'IA. Que vous affiniez des systèmes de conduite autonome, amélioriez les capacités de surveillance ou accélériez les analyses d'imagerie médicale, AITemplate est prêt à révolutionner votre flux de travail. Prêt pour une expérience d'IA transformatrice ? Adoptez la puissance d'AITemplate dès aujourd'hui et libérez tout le potentiel de vos modèles avec un serveur d'inférence ultra-rapide.

More information on AITemplate

AITemplate Alternatives

Plus Alternatives-

TemplateAI : développement d'applications d'IA avec des modèles prédéfinis et des fonctionnalités puissantes. Gagnez du temps et des efforts tout en créant des fonctionnalités d'IA innovantes.

-

-

Utilisez un modèle open-source de pointe, ou peaufinez et déployez le vôtre sans frais supplémentaires, grâce à Fireworks.ai.

-

-

RightNow AI : Optimisez CUDA sans la complexité ! L'IA génère des kernels haute performance à partir d'instructions. Effectuez le profilage sur des GPU serverless.