What is Qwen2.5-Turbo?

Présentation de Qwen2.5-Turbo, un modèle linguistique de grande envergure de pointe développé par Alibaba Cloud. Ce modèle avancé se targue d’une fenêtre de contexte sans précédent d’un million de jetons, soit l’équivalent d’environ 10 romans, 150 heures de discours transcrits, ou 30 000 lignes de code. Qwen2.5-Turbo excelle dans le traitement de textes ultra-longs tout en maintenant des performances impressionnantes sur les tâches de texte court. Il surpasse des concurrents comme GPT-4 dans les benchmarks de textes longs et offre une vitesse d’inférence plus rapide et un coût inférieur.

Caractéristiques clés :

? Fenêtre de contexte étendue :Gère un nombre stupéfiant d’un million de jetons, permettant une compréhension et une analyse plus approfondies de textes volumineux tels que des romans, des référentiels de code et des articles de recherche.

? Vitesse d’inférence plus rapide :Les mécanismes d’attention clairsemée réduisent considérablement le temps de traitement, le rendant 4,3 fois plus rapide que son prédécesseur pour le traitement d’un million de jetons.

? Coût inférieur :Offre un traitement économique à 0,3 ¥ par million de jetons, permettant aux utilisateurs d’analyser 3,6 fois plus de contenu que GPT-4o-mini pour le même prix.

? Performances élevées sur toutes les tâches :Excelle dans les tâches de texte long et court, surpassant d’autres modèles open source ayant des longueurs de contexte similaires et atteignant des performances comparables à celles de GPT-4o-mini et Qwen2.5-14B-Instruct sur des textes plus courts.

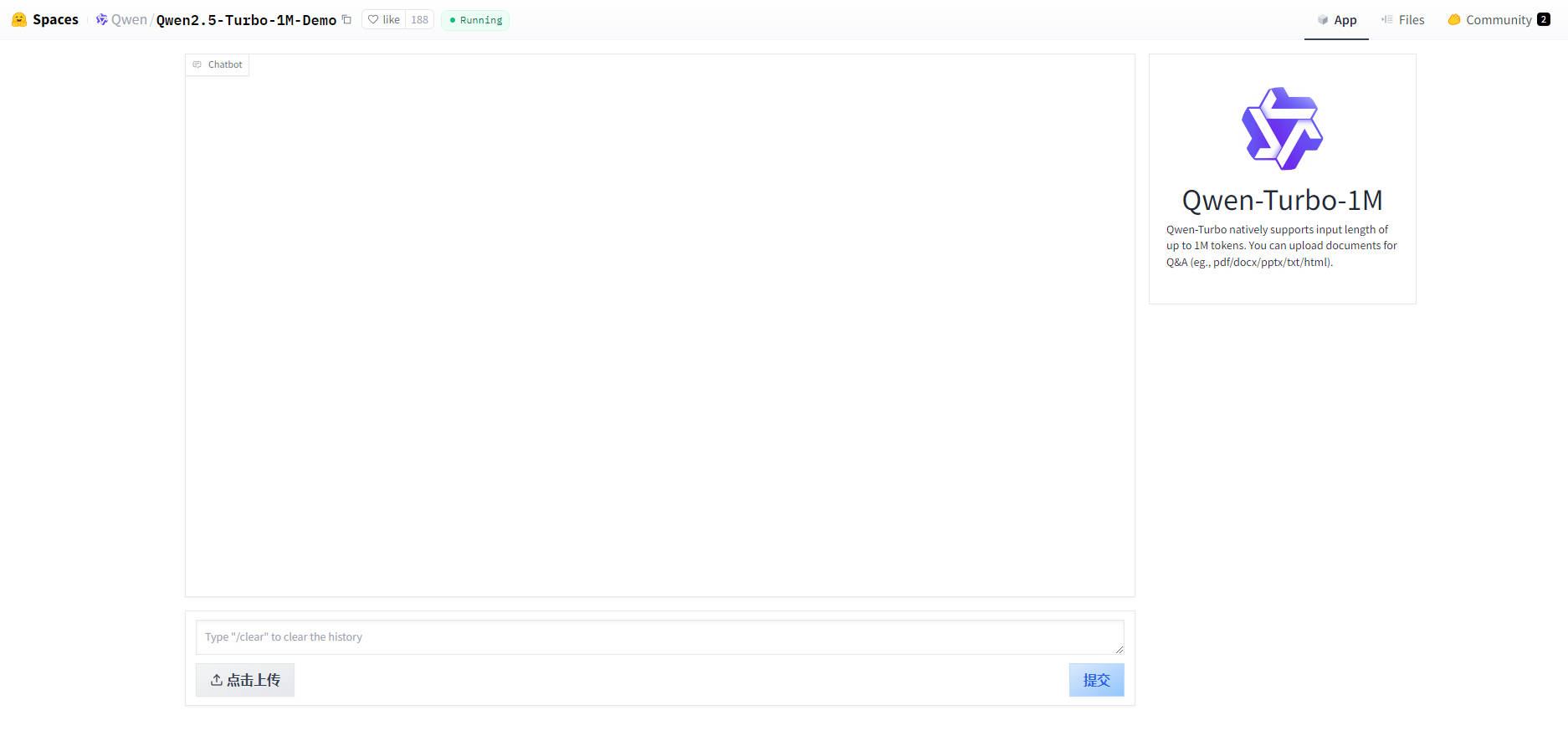

? Accessible via plusieurs plateformes :Disponible via l’API Alibaba Cloud Model Studio, la démo HuggingFace et la démo ModelScope pour une intégration et une expérimentation transparentes.

Cas d’utilisation :

Résumer des articles de recherche complexes dans diverses disciplines.

Analyser et extraire des informations de documents juridiques ou de contrats volumineux.

Construire une IA conversationnelle avancée capable de maintenir le contexte lors d’interactions prolongées.

Conclusion :

Qwen2.5-Turbo ouvre de nouvelles perspectives pour les applications d’IA nécessitant une compréhension approfondie du contexte. Ses performances supérieures, son efficacité et son prix abordable en font un choix idéal pour les chercheurs, les développeurs et les entreprises souhaitant exploiter la puissance des grands modèles linguistiques pour les tâches impliquant de grands volumes de texte.

FAQ :

Qu’est-ce qu’un jeton dans le contexte des grands modèles linguistiques ?

Un jeton peut être un mot, une partie de mot ou un signe de ponctuation. C’est l’unité de base du texte traitée par le modèle.

Comment Qwen2.5-Turbo gère-t-il les textes de plus d’un million de jetons ?

Actuellement, le modèle est limité à un million de jetons. Pour les textes plus longs, les utilisateurs devront peut-être les diviser en plus petits morceaux et les traiter séparément.

Qwen2.5-Turbo est-il disponible pour un usage commercial ?

Consultez la documentation Alibaba Cloud Model Studio pour plus de détails sur les licences et les conditions d’utilisation pour un usage commercial.

More information on Qwen2.5-Turbo

Qwen2.5-Turbo Alternatives

Plus Alternatives-

-

Les modèles linguistiques de la série Qwen2.5 offrent des capacités améliorées avec des ensembles de données plus importants, une plus grande quantité de connaissances, de meilleures compétences en codage et en mathématiques, et un alignement plus étroit sur les préférences humaines. Open-source et disponible via API.

-

CodeQwen1.5, un modèle expert en code de la famille open source Qwen1.5. Avec ses 7B paramètres et son architecture GQA, il prend en charge 92 langages de programmation et gère les entrées contextuelles jusqu'à 64 Ko.

-

-