What is Qwen2.5-Turbo?

阿里云重磅推出Qwen2.5-Turbo,一款尖端的超大型语言模型。该模型拥有前所未有的百万token上下文窗口,相当于约10部小说、150小时的语音转录或30,000行代码。Qwen2.5-Turbo在处理超长文本的同时,在短文本任务上也保持了令人印象深刻的性能。在长文本基准测试中,它超越了GPT-4等竞争对手,并提供更快的推理速度和更低的成本。

关键特性:

? 超长上下文窗口:处理惊人的百万token,能够更深入地理解和分析小说、代码库和研究论文等海量文本。

? 更快的推理速度:稀疏注意力机制显著减少了处理时间,在处理百万token时比其前代产品快4.3倍。

? 更低的成本:每百万token仅需0.3元人民币,用户可以以相同的成本分析比GPT-4o-mini多3.6倍的内容。

? 强大的跨任务性能:在长文本和短文本任务中均表现出色,超越了具有相似上下文长度的其他开源模型,并在短文本方面达到了与GPT-4o-mini和Qwen2.5-14B-Instruct相当的性能。

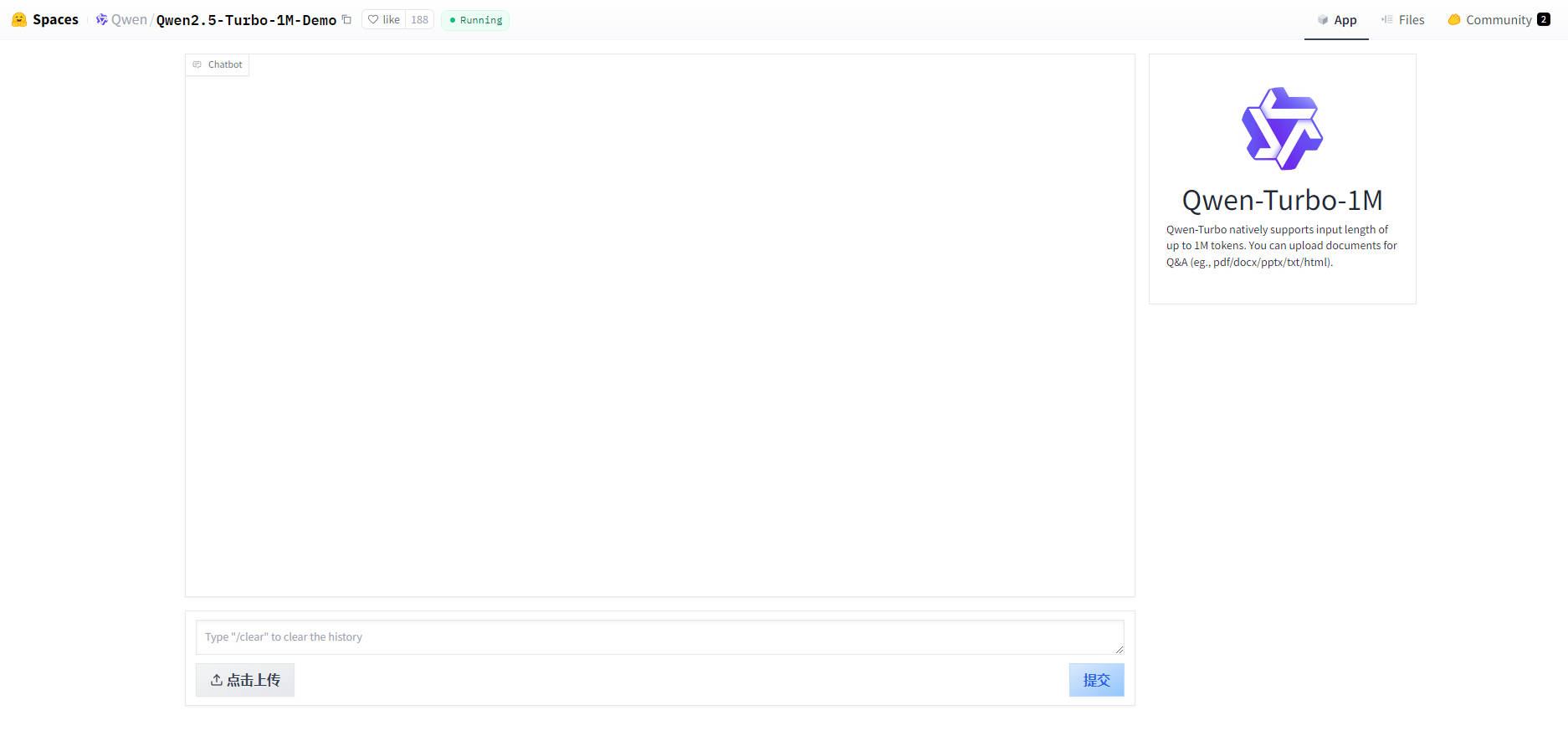

? 多平台访问:通过阿里云模型服务API、HuggingFace Demo和ModelScope Demo提供访问,方便集成和实验。

应用场景:

总结跨学科的复杂研究论文。

分析和提取冗长的法律文件或合同中的信息。

构建能够在长时间交互中保持上下文的高级对话式AI。

总结:

Qwen2.5-Turbo为需要广泛上下文理解的AI应用开辟了新的可能性。其卓越的性能、效率和经济性使其成为研究人员、开发人员和企业利用大型语言模型处理海量文本任务的理想选择。

常见问题:

在大语言模型的语境下,token是什么?

token可以是一个词、词的一部分或标点符号。它是模型处理文本的基本单位。

Qwen2.5-Turbo如何处理超过百万token的文本?

目前,模型限制为百万token。对于更长的文本,用户可能需要将其分解成更小的块并分别处理。

Qwen2.5-Turbo可以用于商业用途吗?

请参考阿里云模型服务的文档,了解商业用途的许可和服务条款详情。