What is Ollama?

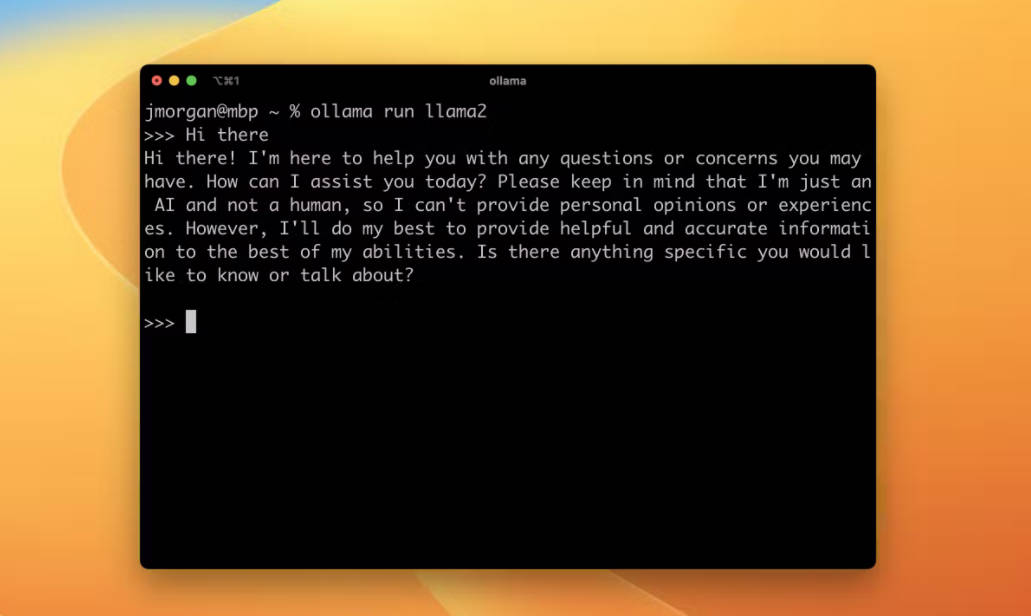

Ollamaは、ユーザーが大きな言語モデルをローカルで実行できるソフトウェアです。macOS、Windows(WSL2経由)、Linux & WSL2に対応しています。また、Docker経由でOllamaをインストールすることもできます。このソフトウェアは、ダウンロードしてカスタマイズ可能なオープンソースモデルのリストをサポートしています。さまざまなモデルを実行するには、最小限のRAMが必要です。Ollamaは、使いやすさを実現するために、CLIリファレンス、REST API、コミュニティ統合も提供しています。

主な機能:

1. ローカルインストール:Ollamaは、ユーザーがそれぞれのマシン上で大きな言語モデルをローカルに実行できるため、利便性とアクセシビリティを提供します。

2. モデルライブラリ:このソフトウェアは、さまざまな目的に合わせてダウンロードして使用できる、さまざまなオープンソースモデルをサポートしています。ユーザーは、Llama 2、Mistral、Dolphin Phi、Neural Chatなどのモデルから選択できます。

3. カスタマイズ:ユーザーは、GGUFモデルのインポート、プロンプトの変更、温度やシステムメッセージなどのパラメータの設定によって、モデルをカスタマイズできます。

ユースケース:

1. 自然言語処理:Ollamaは、テキスト生成、要約、感情分析などの自然言語処理タスクに効果的に使用できます。このソフトウェアは、大きな言語モデルをローカルで実行できるため、より高速かつ効率的な処理が可能です。

2. チャットボット開発:Ollamaのモデルライブラリとカスタマイズオプションにより、開発者はカスタマーサポート、バーチャルアシスタント、対話型会話インターフェイスなど、さまざまなアプリケーション向けのチャットボットモデルを作成してトレーニングすることができます。

3. 研究開発:Ollamaは、研究者や開発者が言語モデルを実験して改善するためのプラットフォームを提供します。このソフトウェアの柔軟性と広範なモデルライブラリにより、自然言語処理の分野におけるさまざまなアプローチや技術を探索することができます。

結論:

Ollamaは、大きな言語モデルをローカルで実行するための強力なツールです。インストールが簡単で、モデルライブラリが充実しており、カスタマイズオプションがあるため、ユーザーは自然言語処理タスクを効率的に実行し、チャットボットを開発し、この分野で研究を行うことができます。このソフトウェアのユーザーフレンドリーなインターフェイスと統合機能は、さまざまな業界の専門家にとって貴重な資産となっています。

More information on Ollama

Top 5 Countries

Traffic Sources

Ollama 代替

Ollama 代替-

Ollama向けのパワフルなGUIを手に入れましょう。OllaManは、デスクトップ上でローカルAIモデルの管理、探索、チャットをシンプルにします。使い方は簡単です。

-

Docker Compose を活用して Ollama の展開を効率化しましょう。シンプルさと効率性を重視して設計されたコンテナ化環境に飛び込みましょう。

-

Llamafile は Mozilla チームによるプロジェクトです。ユーザーは単一のプラットフォームに依存しないファイルを使用して LLM を配布して実行できます。

-

oterm: Ollama用ターミナルUI。モデルのカスタマイズ、チャットの保存、MCP経由でのツール連携、画像の表示などが可能です。AIワークフローを効率化しましょう!

-

OLMo 2 32B:GPT-3.5に匹敵するオープンソースLLM!コード、データ、重みを無償で提供。研究、カスタマイズ、そしてよりスマートなAIの構築に。