What is Ollama?

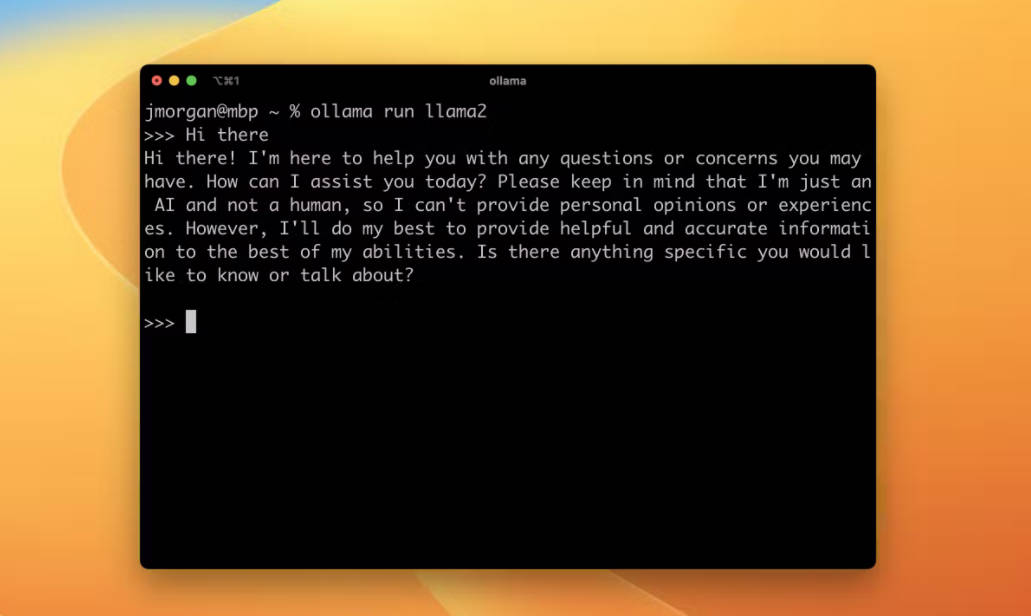

Ollama는 사용자가 대규모 언어 모델을 로컬에서 실행할 수 있게 해주는 소프트웨어입니다. macOS, Windows(WSL2를 통해), Linux & WSL2에서 사용할 수 있습니다. 사용자는 Docker를 통해 Ollama를 설치할 수도 있습니다. 이 소프트웨어는 다운로드 및 사용자 지정이 가능한 오픈소스 모델 목록을 지원합니다. 다양한 모델을 실행하려면 최소한의 RAM이 필요합니다. 또한 Ollama는 사용하기 쉬운 CLI 참조, REST API 및 커뮤니티 통합을 제공합니다.

주요 기능:

1. 로컬 설치: Ollama를 사용하면 사용자가 대규모 언어 모델을 자신의 기계에서 로컬로 실행할 수 있어 편리하고 쉽게 접근할 수 있습니다.

2. 모델 라이브러리: 이 소프트웨어는 다양한 오픈소스 모델을 지원하여 다양한 목적으로 다운로드하여 사용할 수 있습니다. 사용자는 Llama 2, Mistral, Dolphin Phi, Neural Chat 등의 모델을 선택할 수 있습니다.

3. 사용자 지정: 사용자는 GGUF 모델을 가져오고, 프롬프트를 수정하고, 온도와 시스템 메시지와 같은 매개변수를 설정하여 모델을 사용자 지정할 수 있습니다.

사용 사례:

1. 자연어 처리: Ollama는 텍스트 생성, 요약, 정서 분석과 같은 자연어 처리 작업에 효과적으로 사용할 수 있습니다. 로컬에서 대규모 언어 모델을 실행하는 소프트웨어의 기능으로 인해 더 빠르고 효율적인 처리가 가능합니다.

2. 챗봇 개발: Ollama의 모델 라이브러리와 사용자 지정 옵션을 사용하여 개발자는 고객 지원, 가상 비서, 대화형 대화 인터페이스 등 다양한 응용 프로그램을 위한 챗봇 모델을 생성하고 학습할 수 있습니다.

3. 연구 및 개발: Ollama는 연구자와 개발자가 언어 모델을 실험하고 개선할 수 있는 플랫폼을 제공합니다. 소프트웨어의 유연성과 광범위한 모델 라이브러리를 통해 자연어 처리 분야에서 다양한 접근 방식과 기술을 탐구할 수 있습니다.

결론:

Ollama는 대규모 언어 모델을 로컬에서 실행하기 위한 강력한 도구입니다. 사용자는 설치 과정이 간단하고 광범위한 모델 라이브러리와 사용자 지정 옵션을 사용하여 자연어 처리 작업을 효율적으로 수행하고, 챗봇을 개발하고, 이 분야에서 연구를 수행할 수 있습니다. 소프트웨어의 사용자 친화적인 인터페이스와 통합 기능은 다양한 산업의 전문가에게 유용한 자산이 됩니다.

More information on Ollama

Top 5 Countries

Traffic Sources

Ollama 대안

Ollama 대안-

Ollama를 위한 강력한 GUI를 만나보세요. OllaMan을 통해 데스크탑에서 로컬 AI 모델의 관리, 탐색, 채팅이 더욱 간편해집니다. 사용이 매우 간편합니다.

-

Docker Compose를 활용하여 Ollama 배포를 간소화하세요. 단순함과 효율성을 위해 설계된 컨테이너 환경에 뛰어드세요.

-

Llamafile은 Mozilla 팀의 프로젝트입니다. 이를 통해 사용자는 단일한, 플랫폼에 독립적인 파일을 사용하여 LLM을 배포하고 실행할 수 있습니다.

-

Ollama용 터미널 UI인 oterm을 사용해 보세요. 모델을 맞춤 설정하고, 채팅을 저장하며, MCP를 통해 도구를 통합하고, 이미지를 표시할 수 있습니다. AI 워크플로우를 간소화하세요!

-

OLMo 2 32B: GPT-3.5에 견줄 만한 오픈소스 LLM! 코드, 데이터, 가중치를 무료로 제공합니다. 연구, 맞춤 설정, 더 스마트한 AI 구축에 활용해 보세요.