What is NCompass?

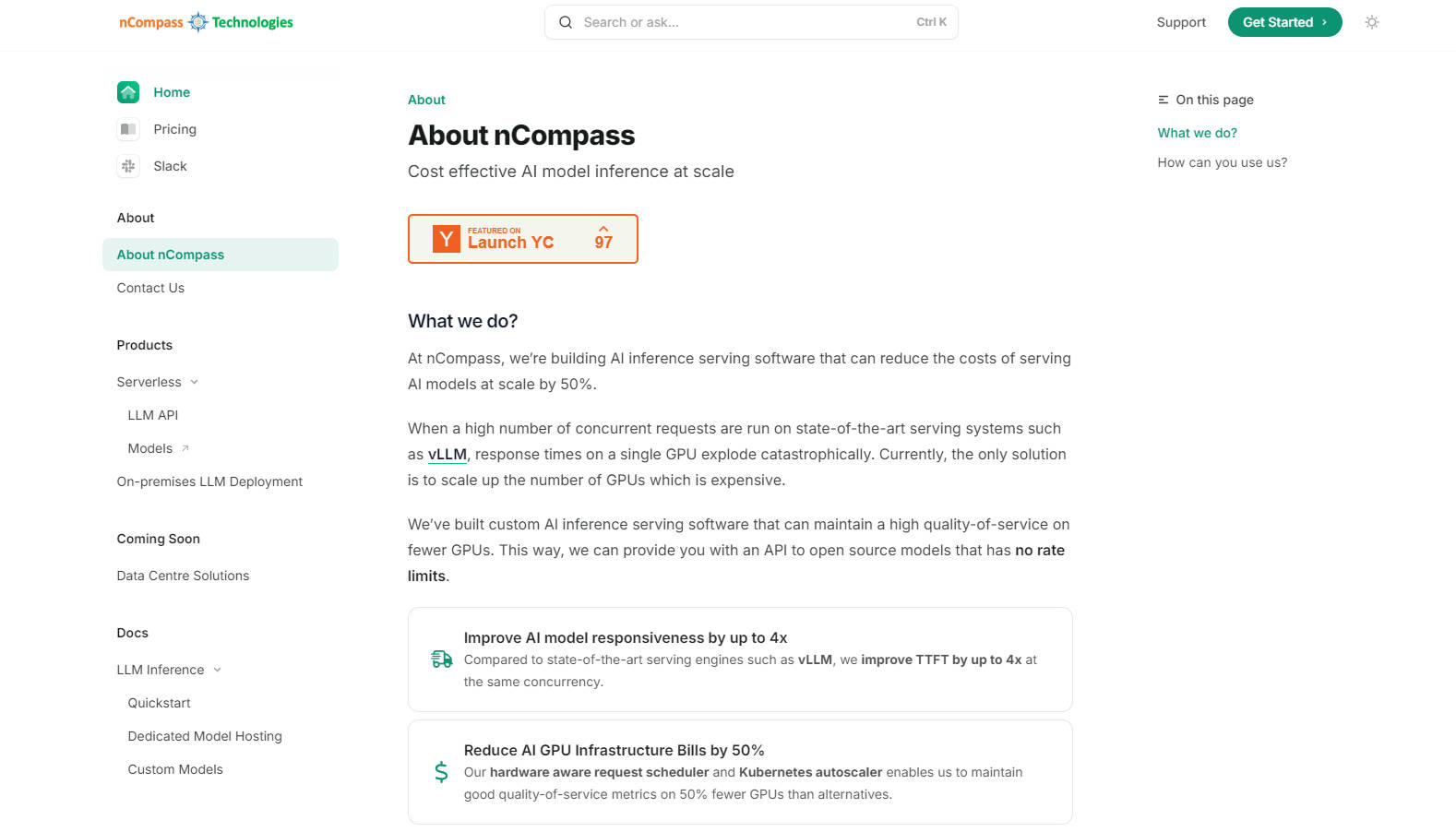

nCompass는 오픈소스 및 맞춤형 대규모 언어 모델(LLM)의 호스팅 및 가속화를 위한 간소화된 솔루션을 제공합니다. AI 인프라 관리의 어려움을 없애면서 강력한 모델에 대한 빠르고 속도 제한 없는 API 액세스를 제공합니다. nCompass를 사용하면 원하는 모델을 선택하고 성능 및 예산 요구 사항을 설정하여 예측 가능한 비용과 향상된 응답성으로 AI 파이프라인에 원활하게 통합할 수 있습니다.

주요 기능:

? 가속화된 모델 호스팅: nCompass는 오픈소스 모델에 최적화된 호스팅을 제공하여 다른 서빙 엔진에 비해 응답 시간을 최대 4배까지 단축합니다.

? 비용 효율적인 확장성: nCompass의 맞춤형 AI 추론 소프트웨어를 통해 GPU 인프라 비용을 50%까지 절감하여 적은 수의 GPU로 효율성을 극대화합니다.

? 속도 제한 없는 API: 속도 제한 없이 LLM에 대한 원활하고 확장 가능한 액세스를 통해 높은 수요에도 안정적인 성능을 보장합니다.

?️ 유연한 배포: 완전히 관리되는 서비스 또는 자체 관리 옵션 중에서 선택하여 인프라에 대한 더 큰 제어권을 확보할 수 있습니다.

사용 사례:

AI 스타트업: LLM 기반 제품을 사용하는 성장 중인 AI 스타트업은 클로즈드소스 모델을 사용하여 느린 응답 시간과 속도 제한에 직면합니다. nCompass로 전환하면 더 빠른 응답 시간과 줄어든 인프라 비용으로 오픈소스 모델을 호스팅하여 제품 개발에 집중할 수 있습니다.

엔터프라이즈 솔루션: 대기업은 데이터 프라이버시 및 제어를 위해 온프레미스 배포가 가능한 맞춤형 LLM 솔루션이 필요합니다. nCompass의 자체 관리 옵션을 통해 기존 인프라에 최적화된 AI 서빙을 통합하면서 높은 성능을 유지할 수 있습니다.

연구 기관: 연구팀은 실험을 위해 다양한 오픈소스 모델에 액세스해야 합니다. nCompass를 사용하면 모델 간에 쉽게 전환하고 성능 및 예산 제약 조건을 설정하며 인프라 관리에 대한 걱정 없이 연구 노력을 확장할 수 있습니다.

결론:

nCompass는 오픈소스 및 맞춤형 LLM의 호스팅 및 가속화 과정을 간소화하여 비용 효율적이고 확장 가능하며 고성능인 솔루션을 제공합니다. nCompass를 선택하면 복잡한 인프라 관리의 부담 없이 강력한 모델에 액세스하여 핵심 비즈니스 또는 연구 목표에 집중할 수 있습니다.