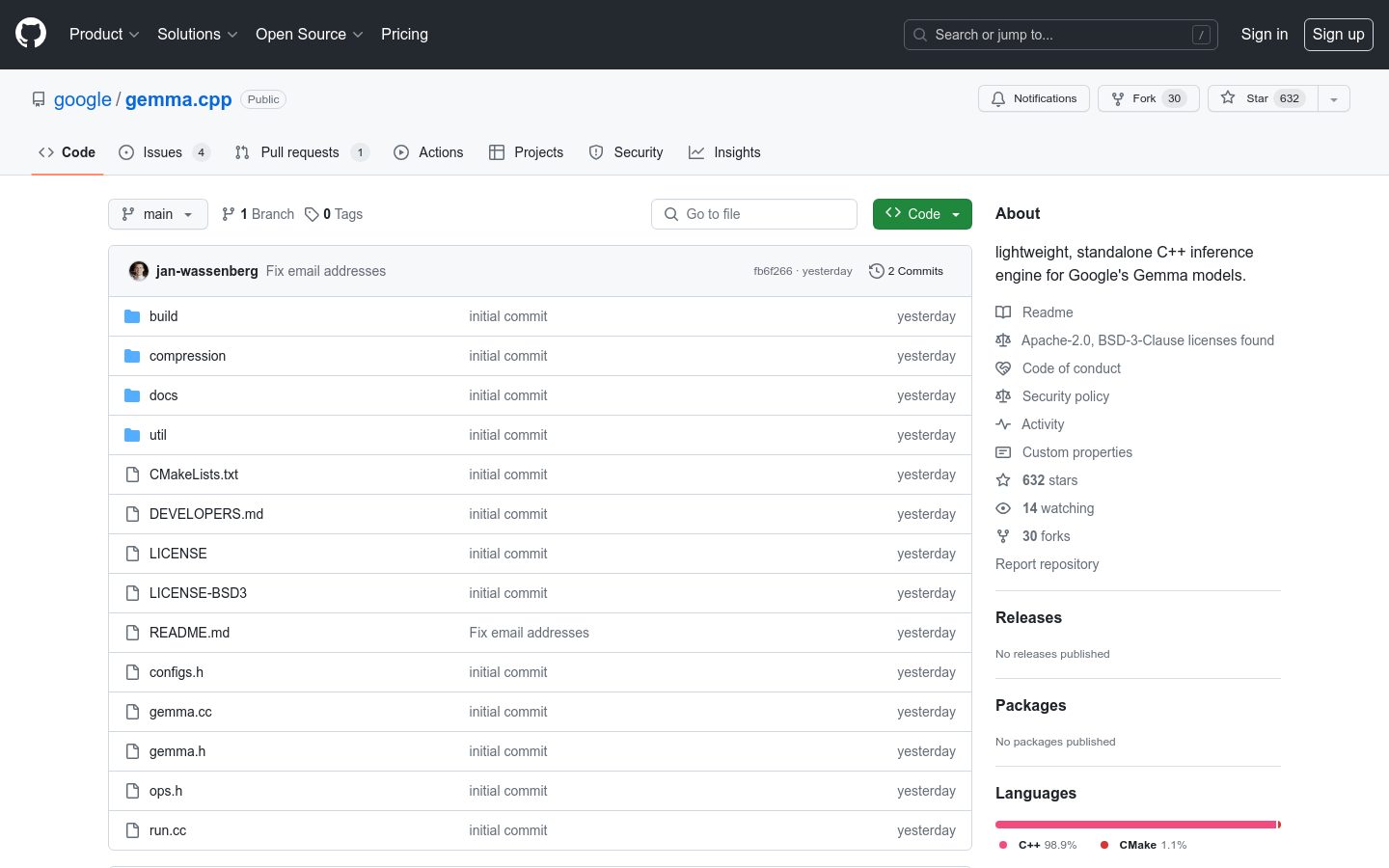

What is Gemma.cpp?

gemma.cpp 是一款轻量级独立 C++ 推理引擎,专为 Google 的 Gemma 基础模型而设计。它提供了 Gemma 2B 和 7B 模型的简化实现,优先考虑简单性和直接性。借助 gemma.cpp,研究人员和开发人员可以轻松试验 Gemma 模型并将其嵌入到项目中,同时还可以受益于其最小的依赖项和可移植性。它适用于实验和研究用例,而面向生产的边缘部署更适合 Python 框架,如 JAX、Keras、PyTorch 和 Transformers。

主要特点:

? 最小化实现:gemma.cpp 提供了 Gemma 2B 和 7B 模型的简化实现,专注于简单性和直接性。

? 实验和研究:它专为实验和研究用例而设计,允许用户在其他项目中轻松嵌入它,且依赖项最少。

? 可移植 SIMD:gemma.cpp 利用 Google Highway 库来利用可移植 SIMD 进行 CPU 推断,确保高效且优化的性能。

用例:

研究和实验:gemma.cpp 非常适合想要试验 Gemma 模型并探索新算法的研究人员和开发人员。它为以最少的依赖项测试和修改 Gemma 模型提供了一个简单而直接的平台。

模型嵌入:gemma.cpp 可以轻松嵌入到其他项目中,允许开发人员将 Gemma 模型纳入他们自己的应用程序和系统。这使得利用 Gemma 的能力成为可能,而无需进行广泛的修改或额外的依赖项。

可移植推理:借助 gemma.cpp,用户可以使用可移植 SIMD 执行 CPU 推断,从而确保在不同系统和体系结构中实现高效且优化的性能。这使其适用于对资源效率和性能至关重要的边缘部署。

结论:

gemma.cpp 是一款轻量级独立 C++ 推理引擎,专为 Google 的 Gemma 基础模型而设计。其极简主义的实现专注于简单性和直接性,使其成为希望试验 Gemma 模型的研究人员和开发人员的绝佳选择。借助 gemma.cpp,用户可以轻松地将 Gemma 模型嵌入到他们的项目中,并受益于其最小的依赖项和可移植 SIMD 以进行高效的 CPU 推断。虽然 gemma.cpp 针对实验和研究用例,但建议对面向生产的边缘部署使用 Python 框架。释放 gemma.cpp 的潜力,立即革新您的研究和开发流程!访问 ai.google.dev/gemma 了解更多信息。