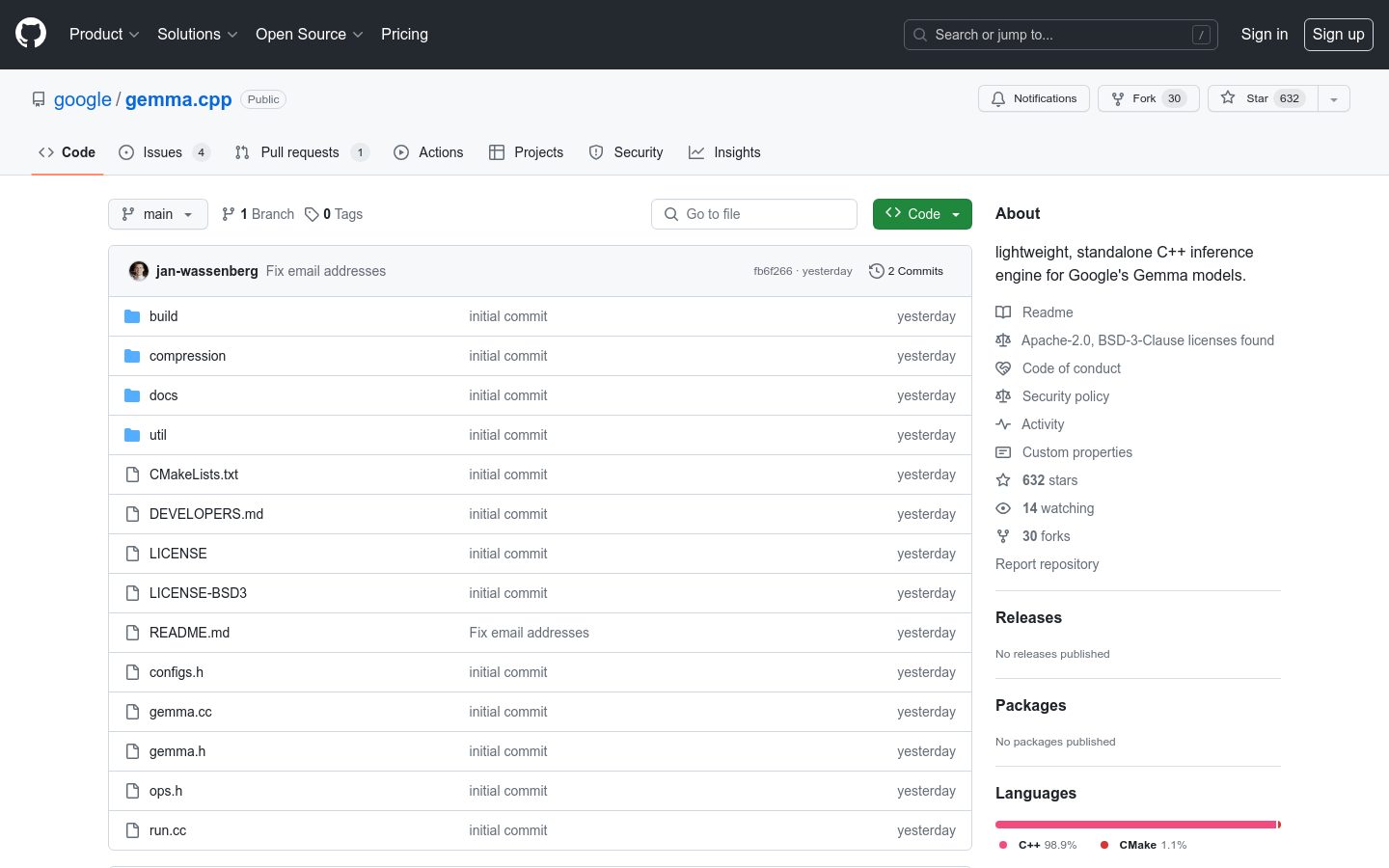

What is Gemma.cpp?

gemma.cppは、GoogleのGemma Foundationモデル用に設計された軽量でスタンドアロンのC++推論エンジンです。複雑さを軽減し、シンプルさと直接性を優先した、Gemma 2Bと7Bモデルの簡略実装を提供します。gemma.cppを使用すると、研究者や開発者はGemmaモデルを簡単に試したり、プロジェクトに埋め込んだりすることができ、最小限の依存関係と移植性も利点として得られます。実験や研究用途におすすめですが、PythonフレームワークのJAX、Keras、PyTorch、Transformerは、本番環境向けのエッジデプロイメントに適しています。

主な機能:

? ミニマリスト実装: gemma.cppは、シンプルさと直接性に焦点を当て、Gemma 2Bと7Bモデルの簡略実装を提供します。

? 実験と研究: 実験や研究の利用を想定しており、最小限の依存関係で他のプロジェクトに簡単に埋め込むことができます。

? 移植可能なSIMD: gemma.cppは、Google Highway Libraryを活用して、CPU推論用に移植可能なSIMDを活用し、効率的で最適化されたパフォーマンスを保証します。

ユースケース:

研究と実験: gemma.cppは、Gemmaモデルの実験を行い、新しいアルゴリズムを探索したい研究者や開発者に最適です。依存関係を最小限に抑えたシンプルでわかりやすいプラットフォームを提供し、Gemmaモデルのテストと変更が可能です。

モデルの埋め込み: gemma.cppは、他のプロジェクトに簡単に埋め込むことができ、開発者は独自のアプリケーションやシステムにGemmaモデルを組み込むことができます。これにより、広範囲にわたる変更や追加の依存関係を必要とせずに、Gemmaの機能を活用できます。

移植可能な推論: gemma.cppを使用すると、ユーザーは移植可能なSIMDを使用してCPU推論を実行でき、さまざまなシステムやアーキテクチャで効率的で最適化されたパフォーマンスを保証します。これにより、リソースの効率性とパフォーマンスが重要なエッジデプロイメントに適しています。

結論:

gemma.cppは、GoogleのGemma Foundationモデル専用に設計された軽量でスタンドアロンのC++推論エンジンです。シンプルさと直接性に焦点を当てたミニマリスト実装により、Gemmaモデルの実験を希望する研究者や開発者にとって優れた選択肢となります。gemma.cppを使用すると、ユーザーは効率的なCPU推論のための最小限の依存関係と移植可能なSIMDを利用でき、Gemmaモデルをプロジェクトに簡単に埋め込むことができます。gemma.cppは実験と研究の利用を想定していますが、本番環境向けのエッジデプロイメントにはPythonフレームワークの使用をお勧めします。gemma.cppの可能性を活用して、今日の研究開発プロセスに革命をもたらしましょう!詳細については、ai.google.dev/gemmaにアクセスしてください。