What is CogVLM & CogAgent?

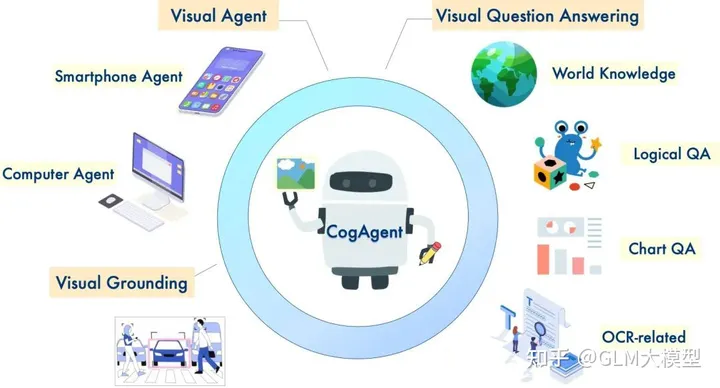

Les modèles de langage visuel open source et excellent en compréhension d’images et dialogue multitour. atteint des performances de pointe sur diverses évaluations intermodales, démontrant ses capacités robustes en légendage d’images, réponse à des questions visuelles et tâches de mise à la terre. , une version améliorée, renforce ces capacités et introduit des fonctionnalités d’agent d’interface graphique, permettant des interactions avec des images haute résolution et l’exécution de tâches sur des captures d’écran d’interface graphique.

et sont des modèles de langage visuel polyvalents qui combinent la compréhension d’image, le dialogue multitour et les fonctionnalités d’agent d’interface graphique. Leurs capacités puissantes en font des atouts précieux pour diverses applications, notamment le raisonnement visuel basé sur le langage naturel, l’interaction et l’automatisation d’interface graphique, les réponses à des questions avec un contexte visuel et la génération de langage avec une entrée visuelle.

Fonctionnalités principales

- Compréhension d’image et dialogue (

): - Gère la compréhension d’image et génère des descriptions détaillées.

- Participe à des dialogues multitours avec un contexte visuel.

- Agent d’interface graphique et capacités améliorées (

): - Prend en charge les entrées d’image haute résolution (jusqu’à 1024x1024) pour une meilleure compréhension visuelle.

- Possède des capacités d’agent d’interface graphique, exécutant des tâches et répondant à des questions liées aux captures d’écran d’interface graphique.

- Démontre des capacités améliorées liées à l’OCR grâce à une formation spécialisée.

- Mise à la terre et modes de dialogue multiples:

- Fournit des descriptions d’image avec des coordonnées de boîte englobante pour les objets.

- Récupère les coordonnées de boîte englobante en fonction des descriptions d’objet.

- Génère des descriptions à partir des coordonnées de boîte englobante spécifiées.

Cas d’utilisation

- Raisonnement visuel en langage naturel :

et excellent dans les tâches qui nécessitent une compréhension visuelle et une génération de langage, telles que le légendage d’images, les réponses à des questions visuelles et les tâches de mise à la terre. - Interaction et automatisation d’interface graphique : les capacités d’agent d’interface graphique de

le rendent adapté aux tâches impliquant des interactions avec des captures d’écran d’interface graphique, telles que les pages Web, les applications et les logiciels. - Réponse à des questions avec un contexte visuel : les deux modèles peuvent répondre à des questions liées aux images, fournissant des réponses informatives qui tirent parti de leur compréhension du contexte visuel.

- Génération de langage avec entrée visuelle : étant donné une image,

et peuvent générer des descriptions détaillées, des histoires ou des dialogues cohérents avec le contenu visuel.

Conclusion

More information on CogVLM & CogAgent

Launched

Pricing Model

Free

Starting Price

Global Rank

Follow

Month Visit

<5k

Tech used

Related Searches