What is StreamingLLM?

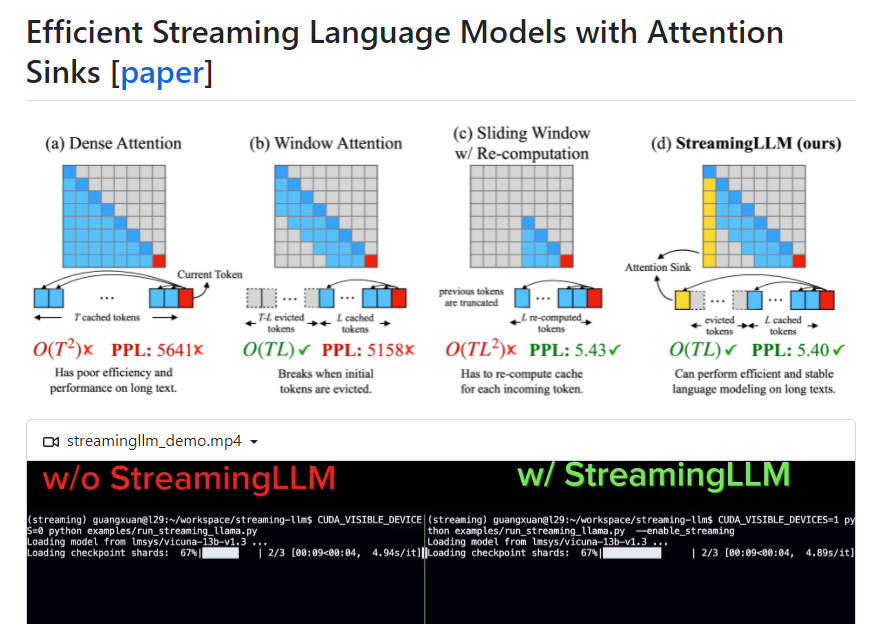

StreamingLLM, est un cadre efficace permettant d'utiliser les grands modèles linguistiques (LLM) dans les applications de streaming sans sacrifier l'efficacité et la performance. Il répond aux défis de la mise en cache des états clés et de valeurs des jetons précédents durant le décodage et de l'incapacité des LLM courants à généraliser à des textes plus longs que leur longueur de séquence d'entraînement. En introduisant des puits d'attention et en conservant les KV des jetons initiaux, StreamingLLM permet aux LLM entraînés avec une fenêtre d'attention de longueur finie de gérer des longueurs de séquence infinies sans ajustement. Il surpasse les lignes de base de recalcul de la fenêtre coulissante avec une accélération jusqu'à 22,2x.

Fonctionnalités clés :

1. Déploiement efficace : StreamingLLM permet d'utiliser les LLM dans les applications de streaming sans compromettre l'efficacité ou les performances.

2. Puits d'attention : En conservant le KV des jetons initiaux comme puits d'attention, StreamingLLM récupère les performances de l'attention de fenêtre même lorsque la longueur du texte dépasse la taille du cache.

3. Généralisation à une longueur de séquence infinie : Avec StreamingLLM, les LLM peuvent gérer des entrées de n'importe quelle longueur sans avoir besoin d'une réinitialisation du cache ou de sacrifier la cohérence.

4. Déploiement de streaming amélioré : L'ajout d'un jeton d'espace réservé comme puits d'attention dédié pendant la pré-formation améliore encore le déploiement du streaming.

5. Optimisation de la vitesse : Dans les réglages de streaming, StreamingLLM atteint une accélération jusqu'à 22,2x comparé aux lignes de base de recalcul de la fenêtre coulissante.

Cas d'utilisation :

1. Dialogues multi-tours : StreamingLLM est optimisé pour les scénarios où les modèles nécessitent un fonctionnement continu sans utilisation intensive de la mémoire ou dépendance sur les données passées, ce qui le rend idéal pour les dialogues multi-tours.

2. Assistants quotidiens basés sur les LLM : Avec StreamingLLM, les assistants quotidiens peuvent fonctionner en continu et générer des réponses basées sur des conversations récentes sans nécessiter d'actualisations du cache ou de recalculs prenant du temps.

StreamingLLM est un cadre efficace qui permet le déploiement des LLM dans les applications de streaming tout en maintenant des performances et une efficacité élevées. En introduisant des puits d'attention et en conservant le KV des jetons initiaux, StreamingLLM permet aux LLM de gérer des longueurs de séquence infinies sans ajustement. Il est particulièrement utile pour les dialogues multi-tours et les assistants quotidiens basés sur les LLM, offrant un déploiement de streaming amélioré et des optimisations de vitesse significatives par rapport aux méthodes traditionnelles.