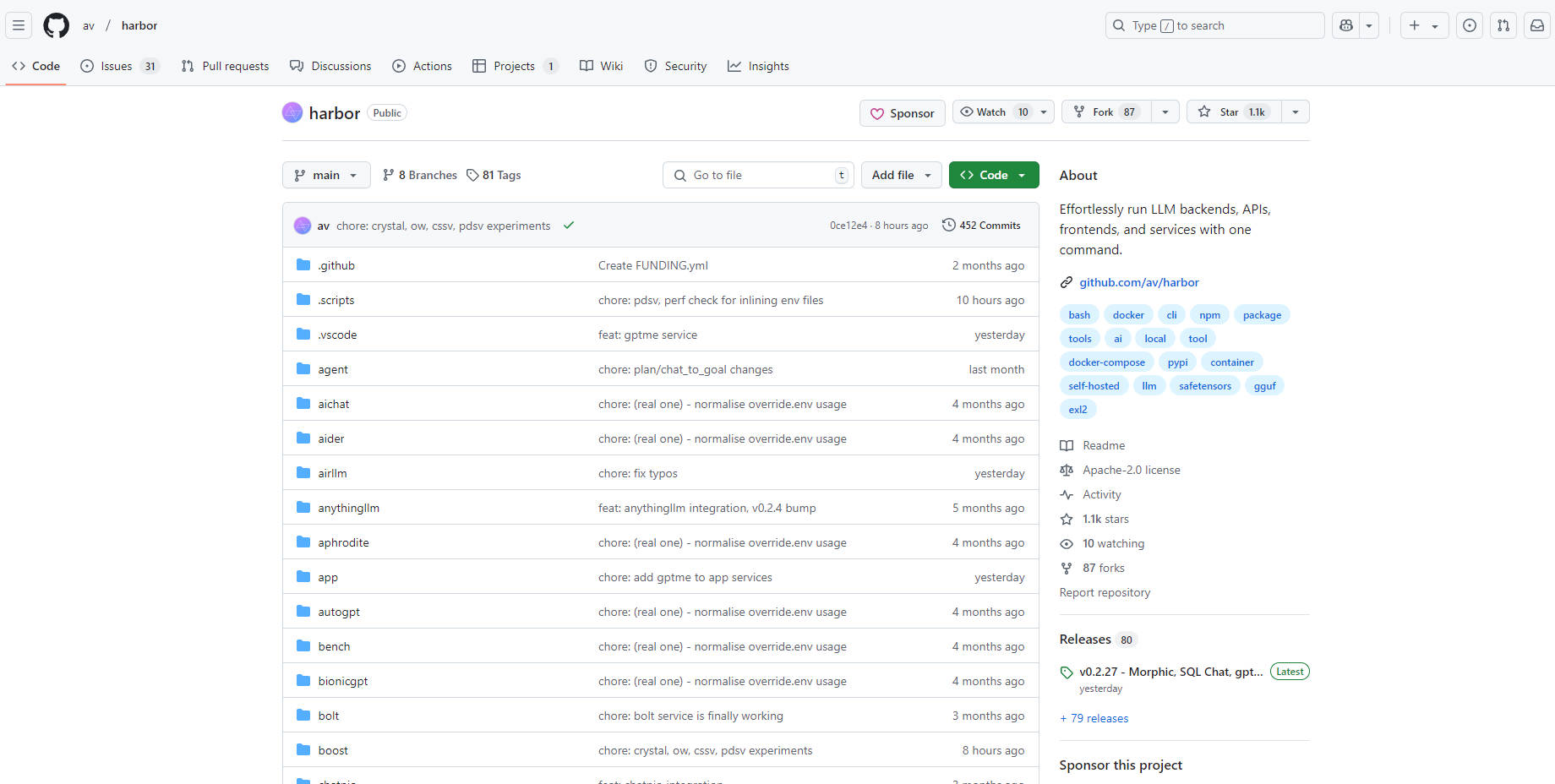

What is Harbor?

是否曾为搭建和管理本地 AI 开发环境的各种组件而感到头疼?您需要在语言模型、API、用户界面之间来回切换……这确实令人头大。Harbor 是一款容器化的 LLM 工具包,旨在消除这种复杂性。它让开发者您能够专注于构建出色的 AI 应用程序,而不是与繁琐的配置作斗争。不妨把它看作您的一站式商店,可以轻松地在本地机器上运行和管理所有 LLM 工具。

主要特性:

🚀 即时启动完整的 LLM 堆栈:只需一个命令 (

harbor up) 即可启动一个功能齐全的环境,包括 Open WebUI 等流行的 UI 和 Ollama 等后端。优势:您可以节省数小时的设置时间,并立即开始试验您的模型。🤝 无缝连接服务:Harbor 会自动配置服务以协同工作。例如,启动 SearXNG 会立即在 Open WebUI 中启用 Web RAG。优势:您可以避免手动配置的噩梦,并确保您的工具能够完美集成。

🎛️ 自定义您的环境:轻松添加或交换组件。需要不同的推理后端?试试

harbor up llamacpp tgi litellm。想要不同的 UI?harbor up librechat chatui。优势:您可以灵活地根据您的特定项目需求定制您的设置,而不会被锁定在僵化的结构中。📁 简化模型管理:使用

harbor llamacpp model https://huggingface.co/user/repo/model.gguf等便捷命令,从 Hugging Face 下载和管理模型。优势:减少寻找模型的时间,将更多时间用于使用它们。服务之间的共享缓存最大限度地减少了冗余下载。💻 统一的 CLI 访问:管理服务和配置,甚至可以直接使用服务 CLI(如

hf或ollama),而无需单独安装。优势:通过提供单一控制点来简化工作流程,减少上下文切换和安装开销。✨提升 LLM 性能:只需一个简单的 'harbor up boost' 命令。优势:提高 LLM 输出的质量。

使用场景:

快速原型设计:您是一位 AI 研究人员,正在探索一个新概念。借助 Harbor,您可以在几分钟内快速设置一个完整的环境,其中包含选定的 LLM 后端、用户友好的界面,甚至还有一个用于 RAG 的搜索引擎。这使您可以快速测试您的想法并更快地迭代。

本地开发和测试:您正在构建一个聊天机器人应用程序。Harbor 允许您完全在本地开发和测试您的应用程序,而无需依赖外部 API 或云服务。您可以轻松地在不同的 LLM 之间切换,以比较它们的性能并微调您的提示。

学习和实验:您是 LLM 世界的新手,并且想要试验不同的工具和模型。Harbor 提供了一个安全便捷的沙盒环境,让您可以探索各种服务的功能,而无需进行复杂的安装和配置。

结论:

Harbor 消除了本地 LLM 开发的痛苦。它提供了一个简化的、用户友好的和高度可配置的环境,使您能够专注于创新,而不是基础设施。无论您是经验丰富的 AI 专家还是刚刚开始您的旅程,Harbor 都提供了一种更简单、更快、更愉快的方式来构建和试验 LLM。它提供了灵活性,以及一种用户友好的方式来处理复杂的本地 LLM 开发世界。