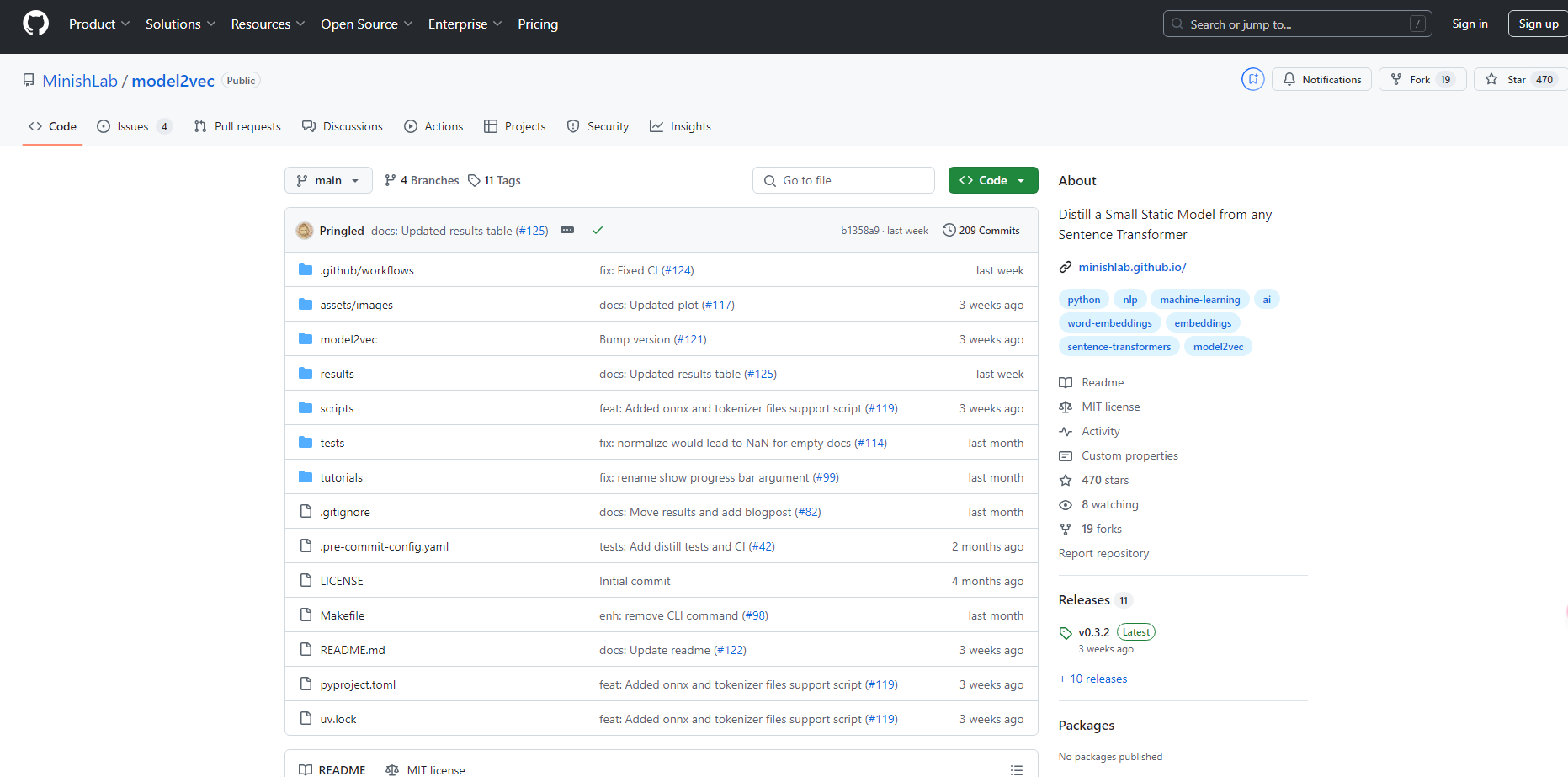

What is Model2vec?

Model2Vec — это революционная технология, которая преобразует любой Sentence Transformer в компактную статическую модель. Сокращая размер модели до 15 раз и увеличивая скорость вывода в 500 раз, Model2Vec позволяет создавать высокопроизводительные модели, которые одновременно быстры и малы. Несмотря на незначительное снижение производительности, Model2Vec остаётся самой эффективной доступной статической моделью для создания эмбеддингов, превосходя альтернативы, такие как GLoVe и BPEmb.

Ключевые особенности:

?️ Компактные модели: Уменьшает размер Sentence Transformer в 15 раз, превращая модель с 120 млн параметров в модель всего с 7,5 млн (30 МБ на диске).

⚡ Сверхбыстрый вывод: Достигает скорости вывода до 500 раз быстрее на процессорах, что делает масштабные задачи быстрее и экологичнее.

?️ Данные не требуются: Дистилляция происходит на уровне токенов, исключая необходимость в наборах данных при создании модели.

? Многоязычная поддержка: Работает без проблем с любым языком, позволяя универсальное использование в разных лингвистических контекстах.

Примеры использования:

Быстрое прототипирование: Разработчики могут быстро создавать небольшие, эффективные модели для тестирования и развертывания без потери производительности.

Многоязычные проекты NLP: Команды, работающие над многоязычными задачами обработки естественного языка, могут легко переключаться между языками и словарями.

Среды с ограниченными ресурсами: Организации с ограниченными вычислительными ресурсами могут использовать быстрые и компактные модели для бесперебойной работы приложений NLP на процессорах.

Заключение:

Model2Vec предлагает инновационное решение для тех, кому необходимы быстрые, компактные и высокопроизводительные модели Sentence Transformer. Значительно уменьшая размер модели и увеличивая скорость вывода, он позволяет эффективно развертывать приложения в различных областях без существенного снижения производительности. Его многоязычные возможности и простота использования ещё больше повышают его привлекательность, делая его предпочтительным выбором для специалистов в области NLP.

Часто задаваемые вопросы:

Насколько Model2Vec может уменьшить размер моей модели Sentence Transformer?

Model2Vec уменьшает размер модели в 15 раз, превращая модель со 120 млн параметров в модель с 7,5 млн параметров.Требуется ли для использования Model2Vec набор данных для дистилляции модели?

Нет, Model2Vec дистиллирует модели на уровне токенов, поэтому для процесса дистилляции не требуется набор данных.Можно ли использовать Model2Vec для многоязычных задач NLP?

Да, Model2Vec поддерживает любой язык, что делает его идеальным для многоязычных проектов NLP.

More information on Model2vec

Model2vec Альтернативы

Model2vec Альтернативы-

KTransformers – это open-source проект, разработанный командой KVCache.AI из Университета Цинхуа и компанией QuJing Tech, предназначенный для оптимизации логического вывода больших языковых моделей. Он снижает требования к аппаратному обеспечению, позволяя запускать модели с 671 миллиардом параметров на отдельных GPU с 24 ГБ VRAM, увеличивает скорость логического вывода (до 286 токенов/с на этапе предварительной обработки и 14 токенов/с на этапе генерации) и подходит для личного, корпоративного и академического использования.

-

Продолжающееся обучение исследовательских моделей трансформаторов в масштабе

-

VectorDB — это простое, легковесное, полностью локальное решение для поиска текста на основе эмбеддингов от начала до конца.

-

DeepSeek-VL2, модель визуального и языкового взаимодействия от DeepSeek-AI, обрабатывает изображения высокого разрешения, обеспечивает быстрые ответы с помощью MLA и показывает превосходные результаты в различных визуальных задачах, таких как VQA и OCR. Идеальна для исследователей, разработчиков и аналитиков бизнес-интеллекта.

-

SmolLM — это серия передовых небольших языковых моделей, доступных в трех размерах: 135M, 360M и 1.7B параметров.