2025年最好的 Aya Vision 8B 替代方案

-

Yi 視覺語言 (Yi-VL) 模型是 Yi 大型語言模型 (LLM) 系列的開放原始碼多模態版本,可進行內容理解、辨識以及關於圖像的多輪對話。

-

GLM-4.5V:賦予您的 AI 卓越視覺能力。可從螢幕截圖生成網頁程式碼、自動化圖形使用者介面,並能運用深度推理,精準分析文件與影片。

-

探索LG AI Research的EXAONE 3.5。這是一套雙語(英語和韓語)指令微調生成式模型,參數規模從24億到320億不等。支援長達32K個詞元的長上下文處理,在真實場景中表現卓越。

-

DeepSeek-VL2 是由 DeepSeek-AI 開發的視覺語言模型,它能夠處理高解析度的圖像,並透過 MLA 提供快速的回應。DeepSeek-VL2 在各種視覺任務中表現出色,例如 VQA 和 OCR。對於研究人員、開發者和 BI 分析師來說,DeepSeek-VL2 是一個理想的選擇。

-

BAGEL:字節跳動-Seed 開源的多模態人工智慧模型。能理解、生成、編輯圖像和文字。功能強大、靈活,堪比 GPT-4o。可用於構建先進的人工智慧應用程式。

-

CogVLM 和 CogAgent 是一款功能強大的開源視覺語言模型,擅長於影像理解和多回合對話。

-

-

解鎖 YaLM 100B 的強大力量,一個類似 GPT 的神經網絡,擁有 1000 億個參數,可以生成和處理文字。全球開發者和研究人員免費使用。

-

-

-

-

-

認識 Falcon 2: TII 發布全新 AI 模型系列,表現超越 Meta 的 Llama 3 Meet Falcon 2: TII Releases New AI Model Series, Outperforming Meta’s New Llama 3

-

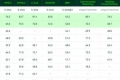

擁有 80 億個參數,該模型在整體效能上超越了 GPT-4V-1106、Gemini Pro、Qwen-VL-Max 和 Claude 3 等專有模型。

-

-

-

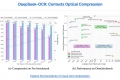

運用 DeepSeek-OCR,大幅提升大型語言模型 (LLM) 的運作效率。將視覺文件壓縮達十倍,並維持高達 97% 的準確性。協助處理海量數據,為人工智慧 (AI) 訓練及企業數位轉型提供強大支援。

-

Shisa V2 405B: 日本性能最優異的雙語大型語言模型。為您的進階應用程式帶來世界級的日語及英語AI效能。開放原始碼。

-

LongCat-Flash 助您解鎖強大AI,輕鬆駕馭代理式任務。這款開源 MoE LLM 不僅提供無與倫比的效能,更兼具高性價比與極速推論。

-

Janus: 解耦視覺編碼以實現統一的多模態理解和生成 Janus: Decoupling Visual Encoding for Unified Multimodal Understanding and Generation

-

-

DreamOmni2 是一款專為智慧影像編輯而設計的多模態人工智慧模型,讓使用者能依據文字或視覺提示,輕鬆調整影像中的物件、光線、材質與風格等元素,進而修改現有的視覺內容。

-

-

XVERSE-MoE-A36B:由 XVERSE Technology Inc. 開發的多語言大型語言模型。

-

-

PolyLM 是一款革命性的多語言大型語言模型 (LLM),支援 18 種語言,在各種任務中表現卓越,且為開源項目。非常適合開發者、研究人員和企業滿足多語言需求。

-

由 Zhipu AI 開發的 CogVideoX-5B-I2V 是一個開源的圖像轉影片模型。透過一張圖片和文字提示,您可以生成 6 秒、720×480 的影片。

-

-

使用 Baichuan-7B 提升您的 NLP 能力——這是個在語言處理與文字生成方面表現優異的開創性模型。探索其雙語能力、多功能應用和令人印象深刻的效能。透過 Baichuan-7B 塑造人機溝通的未來。

-