Las mejores XVERSE-MoE-A36B alternativas en 2025

-

Yuan2.0-M32 es un modelo de lenguaje de Mezcla de Expertos (MoE) con 32 expertos, de los cuales 2 están activos.

-

DeepSeek-V2: modelo MoE de 236 mil millones. Rendimiento líder. Muy asequible. Experiencia inigualable. Chat y API actualizados al modelo más reciente.

-

JetMoE-8B se entrenó con un costo de menos de $ 0,1 millones, pero supera a LLaMA2-7B de Meta AI, que cuenta con recursos de capacitación multimillonarios. La capacitación de LLM puede ser mucho más económica de lo que generalmente se cree.

-

Descubre EXAONE 3.5 de LG AI Research. Un conjunto de modelos generativos ajustados por instrucciones bilingües (inglés y coreano) con parámetros que van de 2.4 mil millones a 32 mil millones. Admite contextos largos de hasta 32 mil tokens, con un rendimiento de primer nivel en escenarios del mundo real.

-

El modelo Yi Visual Language (Yi-VL) es la versión multimodal y de código abierto de la serie Yi Large Language Model (LLM), que permite la comprensión, el reconocimiento y las conversaciones multironda de contenido sobre imágenes.

-

Los modelos de lenguaje de la serie Qwen2.5 ofrecen capacidades mejoradas con conjuntos de datos más grandes, más conocimiento, mejores habilidades de codificación y matemáticas, y una alineación más cercana a las preferencias humanas. De código abierto y disponible a través de API.

-

Qwen2 es la serie de modelos de lenguaje de gran tamaño desarrollada por el equipo de Qwen, Alibaba Cloud.

-

MOSS: un modelo de lenguaje de código abierto que admite chino e inglés con 16 mil millones de parámetros. Ejecútalo en una sola GPU para conversaciones fluidas y soporte de complementos.

-

Seed-X: De código abierto, traducción multilingüe de alto rendimiento para 28 idiomas. Obtenga control, IA transparente y una precisión inigualable.

-

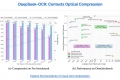

Potencie la eficiencia de los LLM con DeepSeek-OCR. Comprima documentos visuales 10 veces con una precisión del 97%. Procese grandes volúmenes de datos para el entrenamiento de IA y la digitalización empresarial.

-

Hunyuan-MT-7B: Traducción automática de IA de código abierto. Domina más de 33 idiomas con una precisión contextual y cultural insuperable. Ganador de WMT2025, ligero y eficiente.

-

Qwen2-VL es la serie de modelos lingüísticos de gran tamaño multimodales desarrollada por el equipo de Qwen, Alibaba Cloud.

-

GLM-130B: un modelo preentrenado bilingüe abierto (ICLR 2023)

-

Eagle 7B: superando a los transformadores con 1 billón de tokens en más de 100 idiomas (RWKV-v5)

-

¡OLMo 2 32B: El LLM de código abierto que desafía a GPT-3.5! Código, datos y pesos gratuitos. Investiga, personaliza y crea una IA más inteligente.

-

Libera el poder de la IA para tareas agentivas con LongCat-Flash. El MoE LLM de código abierto ofrece un rendimiento sin precedentes y una inferencia ultrarrápida y rentable.

-

Mejora las capacidades de NLP con Baichuan-7B, un modelo innovador que destaca en el procesamiento del lenguaje y la generación de texto. Descubre sus capacidades bilingües, aplicaciones versátiles y rendimiento impresionante. Da forma al futuro de la comunicación hombre-computadora con Baichuan-7B.

-

DeepSeek LLM, un modelo de lenguaje avanzado compuesto por 67 mil millones de parámetros. Ha sido entrenado desde cero en un amplio conjunto de datos de 2 billones de tokens en inglés y chino.

-

GLM-4-9B es la versión de código abierto de la última generación de modelos pre-entrenados en la serie GLM-4, lanzada por Zhipu AI.

-

GPT-NeoX-20B es un modelo de lenguaje autoregresivo de 20 mil millones de parámetros entrenado en el Conjunto de Datos utilizando la biblioteca GPT-NeoX.

-

Los modelos CogVideoX se basan en la tecnología avanzada de modelos a gran escala para satisfacer las necesidades de aplicaciones de calidad comercial.

-

C4AI Aya Vision 8B: IA de visión multilingüe de código abierto para la comprensión de imágenes. Reconocimiento óptico de caracteres (OCR), subtitulado y razonamiento en 23 idiomas.

-

Una novedosa arquitectura de Modelo de Lenguaje de Gran Tamaño Multimodal (MLLM), diseñada para alinear estructuralmente las incrustaciones visuales y textuales.

-

Desbloquee la potente comprensión de texto multilingüe con Qwen3 Embedding. #1 MTEB, más de 100 idiomas, modelos flexibles para búsqueda, recuperación e IA.

-

Una familia de modelos de lenguaje pionera para aplicaciones de IA avanzadas. Explore modelos de código abierto eficientes con escalado capa por capa para mayor precisión.

-

Molmo AI es un modelo de inteligencia artificial multimodal de código abierto desarrollado por AI2. Puede procesar y generar varios tipos de datos, incluyendo texto e imágenes.

-

ChatGLM-6B es un modelo abierto CN&EN con 6.2B paras (optimizados para respuesta a preguntas y diálogos en chino por ahora).

-

MiniCPM es un LLM de fin lateral desarrollado por ModelBest Inc. y TsinghuaNLP, con solo 2.4B parámetros excluyendo incrustaciones (2.7B en total).

-

BAGEL: IA multimodal de código abierto de ByteDance-Seed. Comprende, genera y edita imágenes y texto. Potente, flexible y comparable a GPT-4o. Desarrolle aplicaciones de IA avanzadas.

-

Llama 4 de Meta: IA abierta con MoE. Procesa texto, imágenes y vídeo. Ventana de contexto enorme. ¡Crea de manera más inteligente y rápida!